Op 17 juni 2020 vond The Hmm over deepfakes plaats, een evenement op ons zelfgebouwde livestream-platform live.thehmm.nl. Met dit evenement wilden we onderzoeken of deepfakes het nieuwste wapen zijn om nepnieuws te verspreiden, of onschuldig en vooral lollig zijn. We nodigden drie sprekers uit om hier vanuit drie verschillende perspectieven over te vertellen en op te reflecteren.

Explosieve groei deepfakes

Als eerste was Giorgio Patrini aan het woord, mede-oprichter en CEO van Deeptrace, een organisatie die het deepfake-landschap onderzoekt en in kaart brengt. Daarnaast werken ze aan een oplossing waarmee de integriteit van visuele media kan worden gegarandeerd. Van Giorgio leerden we het volgende:

- Het aantal deepfakes groeit explosief. In de eerste helft van 2020 werden maar liefst 52.000 nieuwe deepfakes geüpload;

- De meeste deepfakes die gemaakt worden zijn pornografisch van aard;

- Het menselijk oog is erg slecht in het herkennen van deepfakes. Ons antwoord op de vraag ‘is dit een deepfake?’ is maar 8% beter dan een willekeurige gok;

- Deepfake-technieken zijn toegankelijk voor iedereen door open source software die online vrij verkrijgbaar is;

- Als je niet tech-savvy genoeg bent om er zelf een te maken, dan zijn er verschillende blogs waar je een op maat gemaakte deepfake-video kan ‘bestellen’;

- Deepfakes worden gebruikt om desinformatie de wereld in de brengen, en voor fraude via sociale media – maar Giorgio is vooral bezorgd over deepfakes die (de reputatie van) individuën of merken schaden. Hij ziet dit steeds vaker gebeuren.

Volgens Giorgio moeten we de verspreiding van deepfakes zo snel mogelijk stoppen. De detectie-tool Deeptrace is gebaseerd op een data-gedreven, deep learning techniek. Maar de organisatie houdt ook deepfake-makers met slechte bedoelingen in de gaten, en probeert uit te vinden wat hun beweegredenen zijn.

Don’t panic

Volgens socioloog en onderzoeker Jaron Harambam hoeven we ons niet zoveel zorgen te maken. Met zijn presentatie ontleedde hij onze morele paniek rondom de technologie met een blik terug in de tijd. Hij liet ons zien dat:

- Elke nieuwe technologie eerst wordt gezien als een bedreiging. Toen de televisie net bestond, was er dezelfde angst dat deze onze perceptie van waarheid zou beïnvloeden. Sommige mensen waren ervan overtuigd dat zelfs de naam, tell-a-vision, liet zien dat het medium gebruikt zou worden voor manipulatie;

- Het belangrijk is om de video’s in context te plaatsen. Een deepfake van Obama die zegt ‘Trump is a total and complete dipshit’ is duidelijk nep, omdat we Obama hebben leren kennen door zijn media-optredens en weten dat hij nooit zoiets zou zeggen.

Jaron denkt wel dat onze relatie met echt, nep en bewegende beelden aan het veranderen is. Net zoals Photoshop deed met stilstaande beelden, weerhouden deepfake-technieken ons ervan dat we bewegende beelden zomaar vertrouwen.

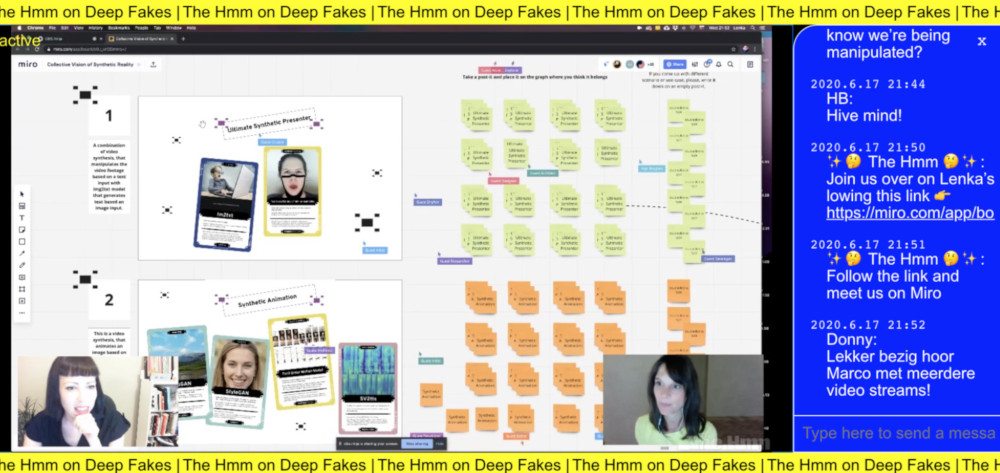

Lenka Hamosova leidt een workshop ethisch denken over deepfakes

De magie van synthetische media

Tot slot liet onafhankelijk research designer en visual speculator Lenka Hamosova ons kennismaken met de magie van deepfakes. Volgens Lenka is wat we momenteel onder ‘deepfake’ verstaan nog maar het topje van de ijsberg. Zij noemt het liever ‘synthetische media’, aangezien met AI-technologie zoveel meer mogelijk is dan face swaps. Via haar brainstorm-kaarten liet ze de oneindige mogelijkheden zien om synthetische werkelijkheden te creëren, en daagde ze ons uit om ook zelf scenario’s te bedenken. Met de StyleGAN technologie kun je neppe personen, neppe katten of neppe huiskamers maken. GauGAN genereert fotorealistische scenario’s gebaseerd op een simpele tekening. Wat als je die twee technieken combineert? Lenka denkt dat:

- Deepfakes het einde van stockfoto’s zullen betekenen;

- Synthetische media al snel in ons dagelijks leven geïntegreerd zullen zijn. Online kledingwinkels kunnen het gender, de lichaamsvorm en huidskleur van hun modellen via AI aanpassen, zodat er geen fotograaf meer nodig is. En het is volgens haar geen gekke gedachte dat, als je een recept voor een cake opzoekt op je telefoon, je een advertentie te zien krijgt waarin je eigen moeder het juiste merk boter aanbeveelt;

- We de creatieve mogelijkheden van deepfakes moeten omarmen, in plaats van er bang voor te zijn. Lenka is zelf maker van deepfakes (of synthetische media) en ze vertelt uit ervaring dat het helpt om meer over de technologie te weten. Dit neemt de angst weg.

Het is dus belangrijk om te begrijpen hoe AI werkt en om na te denken over wat voor toekomst we willen. Daarom nodigde Lenka ons uit voor een interactieve denksessie over de ethische kant van enkele scenario’s. Is het een goede of slechte ontwikkeling dat onze eigen moeder straks in gepersonaliseerde advertenties verschijnt? Gaan deepfakes ons op kleine of grote schaal beïnvloeden? Het belangrijk om hier samen naar te kijken en samen over te discussiëren.

Een deep fake-detector?

De meeste kijkers van het livestream-event waren niet bezorgd dat deepfakes de Amerikaanse verkiezingen in 2020 zouden beïnvloeden. Ze waren er wel van overtuigd dat we een tool nodig hebben om deepfakes op te sporen. We hoeven ons dan misschien geen zorgen te maken dat de technologie onze democratie bedreigt, maar we moeten de gevaren ook niet onderschatten. Persoonlijke afpersing kan ook enorm beschadigend zijn, zoals we beschrijven in ons artikel If deepfakes are a threat, this is it. Het is belangrijk dat we ons bewust zijn van de meest invloedrijke AI-modellen die gebruikt worden om synthetische media te maken. En dat we AI-ethiek samen bespreken. The Hmm over deepfakes was een mooie start hiervan.

Dit verslag verscheen eerder in het Engels op thehmm.nl.

Ook lezen:

» Nepnieuws en deep fake: ‘zien is geloven’ verdwijnt

» Bitefile: Wat zegt de wetenschap over het herkennen en tegengaan van nepnieuws?

» Thema’s voor de toekomst #2 – Artificial intelligence

Reacties worden eerst goedgekeurd door de redactie.